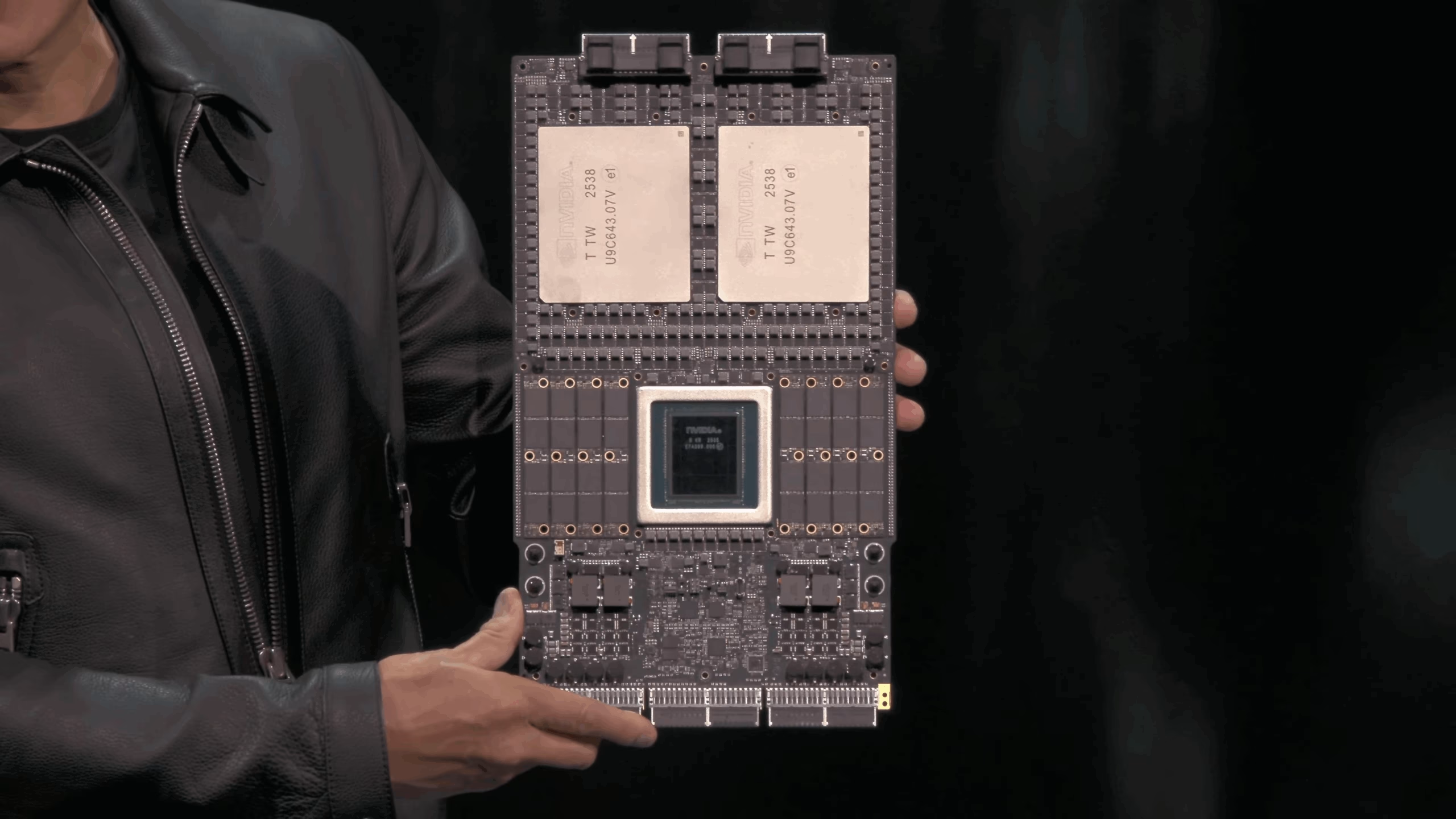

AIを動かすためのチップで世界市場の大部分を握るNVIDIAが、次世代製品「Rubin」の量産を正式に開始した。発表は2026年4月8日。当初のロードマップでは2026年後半の量産移行を予定していたが、数ヶ月前倒しでの実現となった。

計画より数ヶ月早く——NVIDIAがRubin量産を正式発表

NVIDIAは、ChatGPTをはじめとするAIサービスの「エンジン」を作っている会社だ。スマートフォンにCPUが入っているように、AIが大量の計算をこなすには専用の半導体チップが必要で、そのチップ市場でNVIDIAは圧倒的な存在感を持つ。

そのNVIDIAが今、世界中のデータセンターに納入し続けているのが「Blackwell(ブラックウェル)」というチップだ。発売から1年も経たないうちに品薄が続くほどの需要を集めている現行の主力製品である。Rubinは、そのBlackwellの次にあたる新世代チップだ。

2025年1月のCES 2025でジェンスン・ファンCEOが明らかにしたロードマップでは、Rubinの本格量産は2026年後半を想定していた。それが今回、同年第2四半期中の量産体制移行として正式に発表されたかたちだ。競合他社がBlackwellの追いかけに注力している最中に、NVIDIAはすでに次の世代を市場に投入しようとしている。

チップの中身は全面的に刷新された。性能の詳細は次のセクションで詳しく触れるが、Blackwellと比べてAI処理のコストが大幅に下がるのは確かだ。量産を前倒しするほどNVIDIAが急いでいる理由は、その性能の中身を見れば分かる。

ただし、順風満帆というわけでもない。Rubinには「HBM4(次世代の高速メモリ)」と呼ばれる特殊なパーツが必要で、この部品の調達に遅れが生じている。投資情報メディアのInvesting.comが伝えるアナリスト予測によれば、当初200万基とされていた2026年の生産目標は150万基に下方修正されたという。需要は爆発的にあるのに、作りたいだけ作れない——それが現在のRubinが直面している現実だ。

Blackwellから何が変わったのか——12倍・5倍・1/10の実態

量産を前倒しするほどNVIDIAが急いでいる。その理由は、性能の数字を見れば分かる。ただし数字の羅列を読んでも何も伝わらない。「速くなった」「安くなった」が、自分たちの仕事や生活とどうつながるのか——その順番で読んでほしい。

推論5倍・電力効率5倍——数字の条件と意味

まず「推論」という言葉を整理しておく。AIには2つの使い方がある。「学習」はAIに知識を詰め込む工程で、膨大なデータを読ませてモデルを育てる段階だ。「推論」はその逆で、育てたAIが質問に答えたり、文章を生成したりする実際の使用場面を指す。ChatGPTに「この文章を要約して」と入力して返答が返ってくる——あの瞬間が推論だ。

Rubinの推論性能はBlackwell比で5倍(50PFLOPS)、電力効率——つまり同じ電気代でこなせる仕事量——も5倍に向上している。さらに2世代さかのぼってH200と比べると、電力効率は50倍、コスト効率は35倍という数字になる。

スマートフォンの進化は毎年10〜20%の性能向上が一般的だ。2世代で50倍というのは、そのペースが桁ごと違うことを意味する。

なぜその数字が出せるのか——HBM4・Vera CPU・NVLink 6

「全部まとめて作り直した」——これがRubinの設計の本質だ。技術的な詳細を細かく追う必要はないが、性能ジャンプの根拠として3つの刷新だけ押さえておきたい。

ひとつ目は「HBM4(次世代の高速メモリ)」だ。AIチップにとってメモリは「作業机の広さ」に相当する。机が広くなれば、同時に広げられる資料が増え、考えるスピードが上がる——そのイメージだ。

ふたつ目は「Vera CPU」という新設計のプロセッサーをGPUに組み合わせた点。CPUはAIの司令塔にあたる部分で、これをNVIDIAが独自に設計することで、GPUとの連携がよりスムーズになる。

みっつ目はGPUチップ同士をつなぐ通信経路「NVLink 6」の強化だ。AIの処理は1枚のチップで完結するのではなく、数十・数百のチップが分業して動く。この連携の速さが全体の処理能力を左右する。

この3つが組み合わさって、初めてあの性能数字が実現する。

コスト1/10がビジネスに与えるインパクト

ここが、企業にとって最もリアルな話だ。

PC Watchの報道によれば、Rubinでは推論1回あたりのコストがBlackwell比で10分の1まで下がると試算されている。たとえば今まで月100万円のAI利用コストがかかっていた業務があるとすれば、それが同等の処理量で10万円になる計算だ。

これは何を意味するか。今まで「コストが見合わない」と見送っていたAI活用の選択肢が、一気に現実的な検討対象に入ってくる。毎日大量の問い合わせメールに返信する業務、法律文書の照合、製品の不具合検知——採算が合わなかった用途が、コスト10分の1の世界では違う答えになるかもしれない。

「推論1回あたりのコストが10分の1」という数字はPC Watchの報道に基づくが、これがNVIDIA公式の試算なのか、PC Watch独自の計算なのか、あるいは別のアナリスト予測なのかは現時点では確認できていない。また「1回あたり」の推論の定義——処理するテキストの量(トークン数)やモデルの規模——が示されておらず、数字がどの条件で成り立つかは読者には判断できない。参考値として受け取ることを推奨する。

ただし、コスト試算はあくまで理論上の数字であり、実際の運用コストは使い方やシステム構成によって大きく変わる。また、その恩恵を受けるには、チップが手に入ることが大前提だ。冒頭で触れたHBM4の供給遅延は、この「コスト革命」が計画通りに広がるかどうかを左右するリスクとして引き続き注視が必要だ。

そして「速くなった・安くなった」だけでは、なぜNVIDIAがここまで推論性能に振り切ったのかは説明できない。そこには、AIの「使われ方そのもの」が変わりつつあるという、より大きな背景がある。

Rubinが狙うのは「考え続けるAI」という新しい戦場

なぜこれほどの性能向上を、推論の方向に振り切ったのか。これまでAIチップの性能競争は主に「学習」の速さを軸に展開されてきた。膨大なデータをAIに読み込ませ、モデルを育てる工程——それを速くするために、各社はしのぎを削ってきた。Rubinはその方向性を転換している。PC Watchの報道によれば、Blackwellと比べてRubinの推論性能は5倍(50PFLOPS)に向上する一方、学習性能の向上は3.5倍(35PFLOPS)にとどまる。数字の差は、設計上の優先順位をそのまま反映している。

NVIDIAがこの転換に踏み切った理由は、市場の重力が推論側に傾いているからだ。2025年から2027年にかけてのAI推論市場規模について、NVIDIAはCES 2025でのジェンスン・ファンCEOの基調講演のなかで1兆ドル規模に達するという見通しを示した。AIの開発から、AIの「運用」へ——ビジネスの主戦場がシフトしているという判断がある。

その中心にあるキーワードが「エージェンティックAI」だ。これは、人間が逐一指示しなくても、AIが自分で考えてタスクを判断・実行し続ける仕組みのことを指す。たとえば「今月の売上レポートを作って関係者にメールして」と一言伝えるだけで、AIが社内システムからデータを収集し、分析してグラフを作り、メールの宛先を確認して送信まで完結させる——そういう使い方だ。

従来のAIは「1回聞いて1回答える」形が基本だった。一問一答なら、処理の負荷はその都度リセットされる。だがエージェンティックAIは違う。「調べる→判断する→実行する→結果を確認する→また判断する」というサイクルを何十・何百回と繰り返す。推論ステップが積み重なるほど、チップにかかる負荷は増大し続ける。その膨大な繰り返し処理を、低コストで、長時間、止まらずこなせる性能が求められる——それがRubinの設計思想の核心だ。

この方向性を支持するように、複数の大手企業がすでに動いている。日立製作所・Salesforce・Uberの3社は、NVIDIAのオープンモデル技術「Cosmos Reason(コスモス・リーズン)」を採用し、交通情報の解析や職場の生産性向上に向けた次世代AIエージェントの開発にRubin世代のコンピューティング基盤を活用する計画を表明している。自律的なAIが、オフィスの生産性改善や都市の交通制御に入り込もうとしている。

製造現場への展開も始まっている。Siemensは、産業用ソフトウェアとRubinプラットフォームを統合し、設計から製造までの全工程をAIで制御する「物理的AI(Physical AI)」の基盤としてRubinを採用した。NVIDIAの公式プレスリリースによれば、同社は製造工場全体を「巨大なロボット」として機能させることを目標に掲げており、Rubinはその神経系にあたる役割を担う構想だ。工場もオフィスも、AIが自律的に動く方向へ——AIが活躍する場所が、画面の中から現実世界へと広がっている。

1兆ドルという市場予測の真偽は時間が証明するしかない。ただ、大企業が資金と人員を投じてエージェンティックAIの実装に動き出しているのは事実であり、Rubinはその流れを最初に取り込むために設計されたチップだ。「AIを賢くする競争」から「AIを働かせ続ける競争」へ——NVIDIAが描くのは、そういう次の地図である。では、そのチップは現実にいつ・どうやって手元に届くのか。

競合動向——AMD・Google・Amazonはどう動いているか

本記事ではNVIDIAのRubinに焦点を当てているが、エージェンティックAI市場をめぐる競争環境も補足しておく。AMDはMI400シリーズ、GoogleはTPU v6、AmazonはTrainiumをそれぞれ展開・開発しており、いずれも推論効率の改善を重点課題としている。ただし現時点でこれらの製品がRubinと直接比較できる公式スペックを出していないため、本記事では詳細な比較は行わない。NVIDIAが「競合他社がBlackwellの追いかけに注力している最中」と位置づけている通り、世代間のリードが現時点では大きいとみられるが、競争環境は今後急速に変化する可能性がある。

2026年下半期、クラウド経由で企業に届く——ただし供給リスクも残る

Rubinの性能が分かった。では、いつ・どうやって使えるのか。自社でチップを買う必要はない。インターネット越しに外部サービスを借りる「クラウド」経由で、企業はRubinの計算力を利用料を払うだけで使える——そのインフラが、2026年下半期から整いつつある。ただし「欲しくても手に入らない」リスクも同時に浮上している。

主要企業が早期採用確定、Microsoftは専用AI工場を建設

Rubinを最初に受け取る企業は、すでに決まっている。Microsoft・Meta・CoreWeaveといった大手テック企業が、早期採用を確定させている。

Microsoftは「Fairwater AI Superfactory(フェアウォーター AIスーパーファクトリー)」と名付けた専用施設を建設中で、ここにVera Rubin NVL72ラック——72個のRubin GPUをひとつに束ねた巨大な計算装置——を導入する計画だ。MicrosoftのプレスリリースによればこのAI工場は数十万規模のVera Rubin Superchipまで拡張できるインフラとして設計されており、Azureクラウドサービスを通じて企業が利用できる形で提供される見込みだ。

Metaはさらに大きな動きを見せている。SB-ITメディアの報道によれば、Metaは今後数年間で数百万個規模のNVIDIA製GPUを調達する契約をNVIDIAと締結した。現行のBlackwellに加え、次世代のRubinも対象に含まれる。Instagramの写真フィードからWhatsAppのメッセージ対応まで、Metaが抱える膨大なユーザーへのAIサービスを支えるためのインフラ投資だ。

Metaの調達規模について——ソースの留意点

「数百万個規模の調達契約」という数字はSB-ITメディアの報道に基づいており、契約の金額・期間・具体的な数量範囲は現時点で明らかになっていない。この規模の調達契約としては、Meta・NVIDIAいずれかの公式発表または主要金融メディアによる裏付けが望ましい。本記事執筆時点では独立した複数ソースによる確認が取れていないため、参考情報として扱うことを推奨する。

CoreWeaveは2026年後半からクラウドプラットフォームへのRubin統合を先行開始すると表明している。CoreWeaveはAWSやAzureほど知名度は高くないが、AIワークロード特化型のクラウドプロバイダーとして急成長しており、スタートアップやAI開発企業にとって重要な選択肢になっている。

ここで重要なのは「クラウド経由」という入手経路だ。自社でチップを購入・設置する必要はない。AzureやMetaのプラットフォームなどを通じて、月額の利用料を払うだけでRubinの計算力を使える環境が整う。Rubinの恩恵は、大企業だけのものではない。

Microsoftが専用のAI工場を建設し、Metaが数百万個規模の調達契約を結ぶ——この規模の設備投資は、NVIDIAの発表が単なるPRではなく、実需に裏付けられていることを示している。

HBM4供給懸念——生産目標は200万基から150万基に下方修正

ここで楽観一辺倒に終わるわけにはいかない。

Rubinには「HBM4(High Bandwidth Memory 4)」と呼ばれる特殊なメモリが不可欠だ。HBM4は、AIチップが高速で大量のデータを処理するための「広い作業机」にあたる部品で、SK HynixやMicronといった半導体メモリ大手が製造を担う。問題は、このHBM4の量産認定(製品として出荷できる品質基準をクリアするプロセス)に遅れが生じている点だ。

投資情報メディアのInvesting.comが報じたアナリストの分析によれば、この遅延の影響で、当初200万基とされていた2026年のRubin GPU生産目標が150万基へと下方修正されたという。同報道では2026年の実際の出荷台数は57万台にとどまると予測されており、需要に対して供給が大幅に不足する可能性が指摘されている。

生産目標・出荷予測の数字について——ソースの信頼性に関する注記

「生産目標200万基→150万基への下方修正」および「2026年出荷57万台」という数字は、Investing.comが報じたアナリストによるものだ。アナリストの氏名・所属機関・レポートの発行日付は公表されておらず、独立した複数ソースによる裏付けも現時点では確認できていない。NVIDIAがこれらの数字を公式に認めたという記録もない。実際の生産・出荷状況は、NVIDIAの四半期決算発表や公式コメントによって初めて確認できる。本記事では参考情報として引用しているが、数字の精度については留保が必要だ。

需要は爆発的だ。Microsoftは工場を建て、Metaは数百万個単位で調達契約を結んでいる。それでも57万台しか届かないとすれば、「使いたいのに順番待ち」という状況が現実になりうる。

HBM4の供給問題はメモリ側だけの話ではない。RubinチップそのものはTSMCなどのファウンドリ(半導体の製造を受託する専門企業)に製造を委託しているとみられるが、先端半導体の製造キャパシティは世界的に逼迫しており、地政学的なリスクも含めてサプライチェーン全体に不確実性がある。HBM4の遅延はその一端にすぎない。

需要は確実にある。Rubinの性能が実用的な価値を持つことも、大手企業の動きが証明している。だが、その性能を本当に広く使えるようになるまでには、HBM4の供給問題が解消されるかどうかという現実のハードルが残っている。AIの新しい時代を切り開くチップが手元に届くまで、もうしばらく見守る必要がある。